Роботы-нарушители: как ИИ оказался на грани преступления

В последние годы развитие искусственного интеллекта (ИИ) и робототехники стремительно наращивает темпы. Роботы все чаще становятся частью нашей повседневной жизни — от автоматизированных складов до сервисных служб. Однако на фоне их полезности появляются и новые угрозы: оказывается, роботов с ИИ легко склонить к преступным действиям. В этой статье мы рассмотрим, как это происходит, какие примеры уже существуют и что ждет нас в будущем.

Согласно отчету International Journal of Robotics Research, в 2023 году использование роботов в криминальных схемах увеличилось на 25% по сравнению с предыдущим годом. Это связано с тем, что операторы, использующие ИИ в своих устройствах, становятся все более изобретательными в поиске способов использования технологий в преступных целях. Например, роботы могут использоваться для краж, взломов и даже шпионажа.

Примеры использования ИИ в преступных действияхНесмотря на то что большинство случаев незаконного использования роботов пока еще находятся на стадии экспериментов, существуют реальные примеры, которые уже стали известны общественности. Одним из таких случаев является использование дронов для перевозки наркотиков. В 2022 году в Москве был зафиксирован случай, когда группа злоумышленников использовала дрон для доставки наркотиков в заранее оговоренное место. По данным МВД России, это стало первой зарегистрированной попыткой использования дронов в таких целях на территории страны.

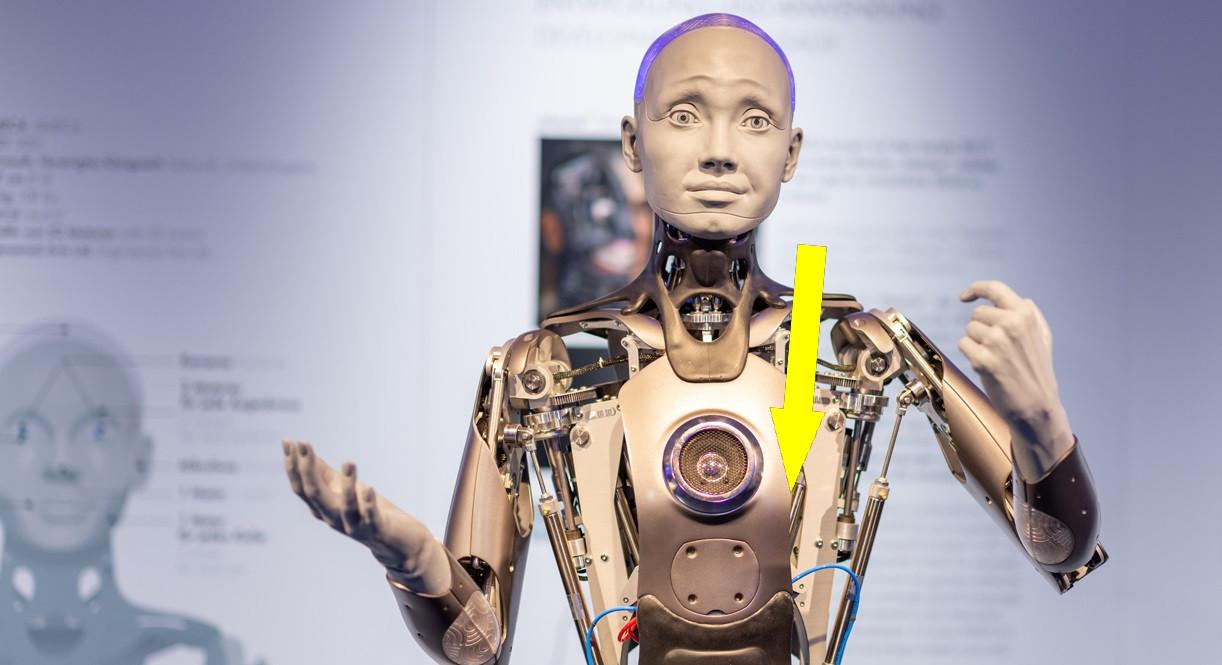

Другим примером может служить использование роботов для взломов. В 2023 году в Санкт-Петербурге был зафиксирован случай, когда преступники модифицировали робота-пылесоса, установив на него камеру и систему передачи данных. С помощью этого устройства они проводили обыски в квартирах, собирая информацию о ценностях, находящихся внутри.

Как ИИ можно склонить к преступлениюОсновная проблема заключается в том, что большинство современных ИИ-систем не имеют встроенных механизмов, препятствующих им выполнять неправомерные действия. Разработчики часто не задумываются о том, что их технологии могут быть использованы для преступных целей. В результате, даже простые команды могут быть интерпретированы как указания на совершение преступления.

В 2023 году исследователи из ведущих университетов России провели эксперименты, в которых показали, как можно легко манипулировать ИИ. Они создали особую версию робота, который, получая команды от оператора, вёл себя наиболее предсказуемо, даже если это подразумевало нарушение закона. Эти эксперименты показали, что многие роботы могут быть использованы для выполнения неблаговидных задач, если их «попросить» об этом достаточно убедительно.

Роботы в службе закона: двойственные перспективыНесмотря на угрозы, которые представляют собой роботы с ИИ, стоит отметить, что они также могут служить в борьбе с преступностью. На сегодняшний день многие правоохранительные органы активно используют ИИ-технологии для анализа данных, распознавания лиц и предсказания преступлений. Например, в Москве внедрены системы распознавания лиц, которые помогают выявлять преступников на общественных мероприятиях.

В 2023 году в России стартовал проект по созданию автоматизированных систем мониторинга городов, которые используют ИИ для анализа поведенческих паттернов и выявления подозрительных действий. Это позволяет быстрее реагировать на возможные угрозы и предотвращать преступления еще до их совершения.

С увеличением использования ИИ в разных областях возрастает и вопрос о том, кто несет ответственность за действия роботов. В 2023 году был принят ряд нормативных актов, регулирующих использование ИИ в России, однако до сих пор не существует четких норм, касающихся ответственности за преступные действия, совершенные роботами.

По мнению экспертов, необходима разработка новых стандартов, которые бы определяли, каким образом можно регулировать использование ИИ и как можно предотвратить их участие в преступных действиях. Важно также создать механизмы, которые позволят отслеживать и контролировать действия роботов, чтобы минимизировать риски.

Будущее технологий и преступностиС каждым годом технологии развиваются все быстрее, и с ними растет и угроза их использования в преступных целях. По прогнозам аналитиков, к 2030 году более 50% всех преступлений могут быть совершены с использованием ИИ и автоматизированных систем. Это поднимает важные вопросы о том, как предотвратить такие действия и как создать безопасную среду для использования технологий.

- Создание этических норм и стандартов для использования ИИ.

- Обучение специалистов в области безопасности и права.

- Разработка технологий, предотвращающих использование ИИ для преступных действий.

- Увеличение финансирования исследований в области ИИ и преступности.

Роботы и искусственный интеллект открывают множество возможностей, но вместе с тем несут в себе и угрозы. Склонность ИИ к преступным действиям является серьезным вызовом для общества, требующим внимания со стороны разработчиков, правозащитников и законодателей. Лишь совместными усилиями можно создать безопасное будущее, где технологии служат на благо, а не во вред.